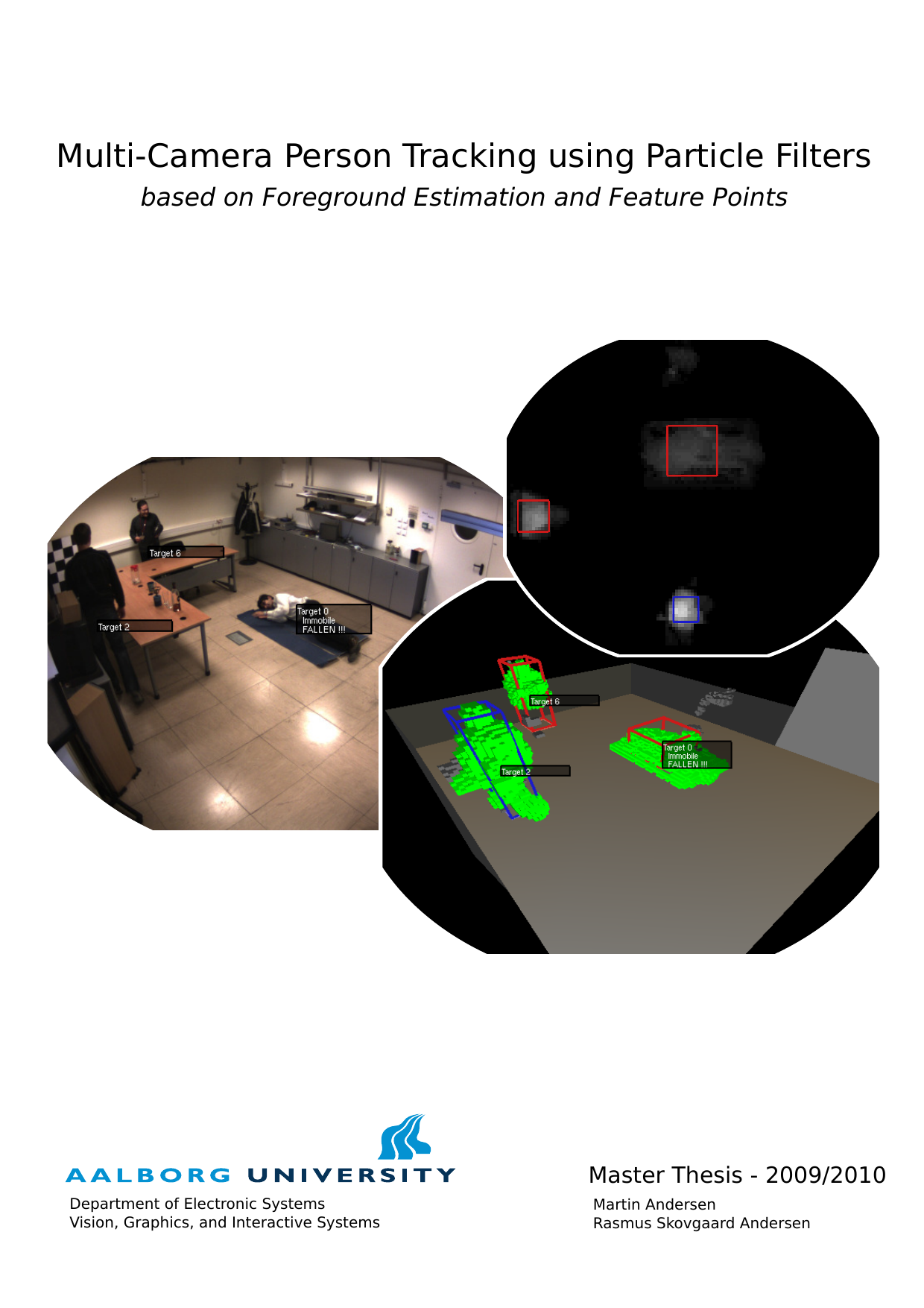

Multi-Camera Person Tracking using Particle Filters based on Foreground Estimation and Feature Points

Authors

Andersen, Rasmus Skovgaard ; Andersen, Martin

Term

4. term

Publication year

2010

Abstract

Many applications rely on sensing people’s presence and state, and the need is growing as the average age in Western societies rises—for example in assistive living environments for older adults. This project develops a person-tracking system for spaces covered by multiple cameras, with this application in mind. The system combines two complementary cues: foreground (motion relative to a learned background) and feature points (distinct image points). Foreground is available when a person moves, while feature points initialized on a person can be tracked even when the person is stationary. For each camera, we estimate a background model using Gaussian Mixture Models (a statistical approach) and extract 2D foreground. Foreground from all cameras is then fused into a single voxel-based 3D foreground (voxels are 3D pixels). Feature points are initialized for each person in each camera and tracked in 2D using the KLT tracker (Kanade–Lucas–Tomasi). Finally, layered sampling is applied to combine foreground and feature-point information into a particle filter for each person (a probabilistic estimator), producing robust tracks. The system runs on one computer with recorded video, and part of it runs live, distributed across multiple computers. Tests on the CLEAR 2007 dataset show that combining both cues outperforms tracking based on only one.

Mange anvendelser bygger på at registrere menneskers tilstedeværelse og tilstand, og behovet vokser i takt med den stigende gennemsnitsalder i Vesten—f.eks. i støttende boligmiljøer for ældre. Dette projekt udvikler et personsporingssystem til miljøer med flere kameraer, med denne anvendelse for øje. Systemet kombinerer to supplerende sporingssignaler: forgrund (bevægelse i forhold til en lært baggrund) og feature-punkter (karakteristiske billedpunkter). Forgrunden er til stede når en person bevæger sig, mens feature-punkter, der er initialiseret på en person, kan spores selv når personen står stille. For hvert kamera estimeres en baggrundsmodel med Gaussian Mixture Models (en statistisk model), og der udtrækkes 2D-forgrund. Forgrunde fra alle kameraer kombineres derefter til én samlet 3D-forgrund baseret på voxler (3D-pixels). Feature-punkter initialiseres for hver person i hvert kamera og spores individuelt i 2D med KLT-sporeren (Kanade–Lucas–Tomasi). Til sidst anvendes lagdelt sampling til at samle information fra forgrund og feature-punkter i et partikelfilter for hver person (en sandsynlighedsbaseret estimator), hvilket giver robuste spor. Systemet er implementeret til at køre på én computer med videooptagelser, og dele af systemet kører live, distribueret mellem flere computere. Tests på CLEAR 2007-datasættet viser, at kombinationen af de to sporingssignaler giver bedre ydelse end et system baseret på kun ét af dem.

[This apstract has been rewritten with the help of AI based on the project's original abstract]

Keywords