Attended Relational Reasoning for Visual Question Answering

Author

Petersen, Lasse Just

Term

4. term

Education

Publication year

2018

Abstract

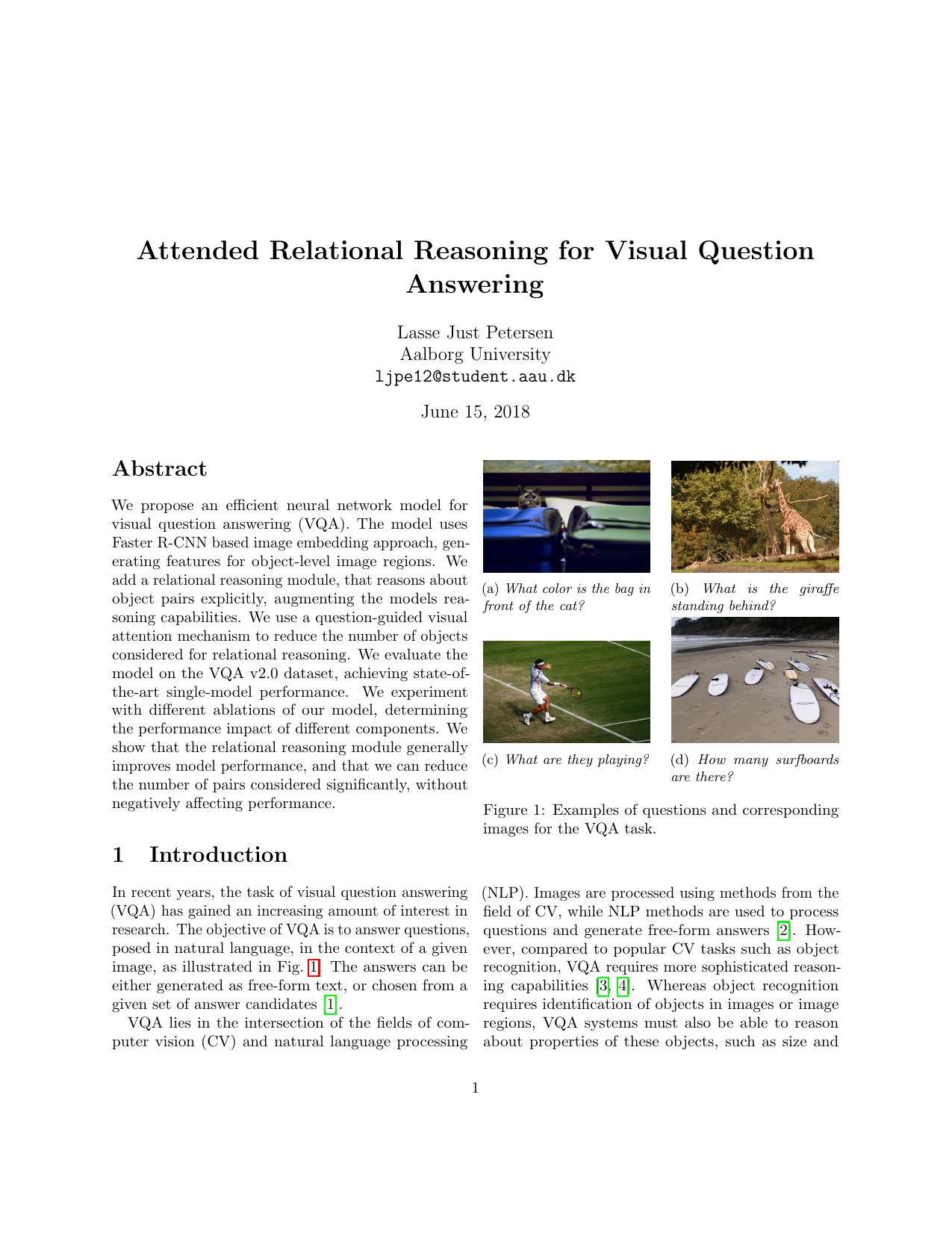

This thesis investigates improving visual question answering by explicitly modeling relations between objects in images. We present an efficient, end-to-end trainable model that combines Faster R-CNN–based object-level image features, a GRU-based question representation, question-guided visual attention to select relevant objects, and a relation module inspired by Relation Networks to perform pairwise reasoning over the selected objects. By restricting the number of object pairs through attention, we reduce computation without harming accuracy. Evaluated on VQA v2.0, the model achieves state-of-the-art single-model performance. Ablation studies indicate that the relation module generally improves results and that the number of considered pairs can be cut substantially without degrading performance.

Dette speciale undersøger, hvordan visuel spørgsvar (VQA) kan forbedres ved eksplicit at modellere relationer mellem objekter i et billede. Vi præsenterer en effektiv, end-to-end trænbar model, der kombinerer objekt-niveau billedrepræsentationer udvundet med Faster R-CNN, en GRU-baseret repræsentation af spørgsmålet, spørgsmaalsstyret visuel opmærksomhed til at udvælge relevante objekter og et relationsmodul inspireret af Relation Networks til parvis ræsonnering over de udvalgte objekter. Ved at begrænse antallet af objektpar via opmærksomhed reducerer vi beregningsomkostninger uden at forringe nøjagtigheden. Modellen evalueres på VQA v2.0 og opnår state-of-the-art ydeevne for en enkelt model. Ablationsstudier viser, at relationsmodulet generelt forbedrer præstationen, og at antallet af overvejede objektpar kan reduceres betydeligt uden negativ effekt.

[This apstract has been generated with the help of AI directly from the project full text]

Keywords

VQA ; Faster R-CNN ; Attention