A Novel Approach for Reflectance Capture

Author

Ladefoged, Kasper Skou

Term

4. term

Publication year

2016

Submitted on

2016-09-09

Pages

67

Abstract

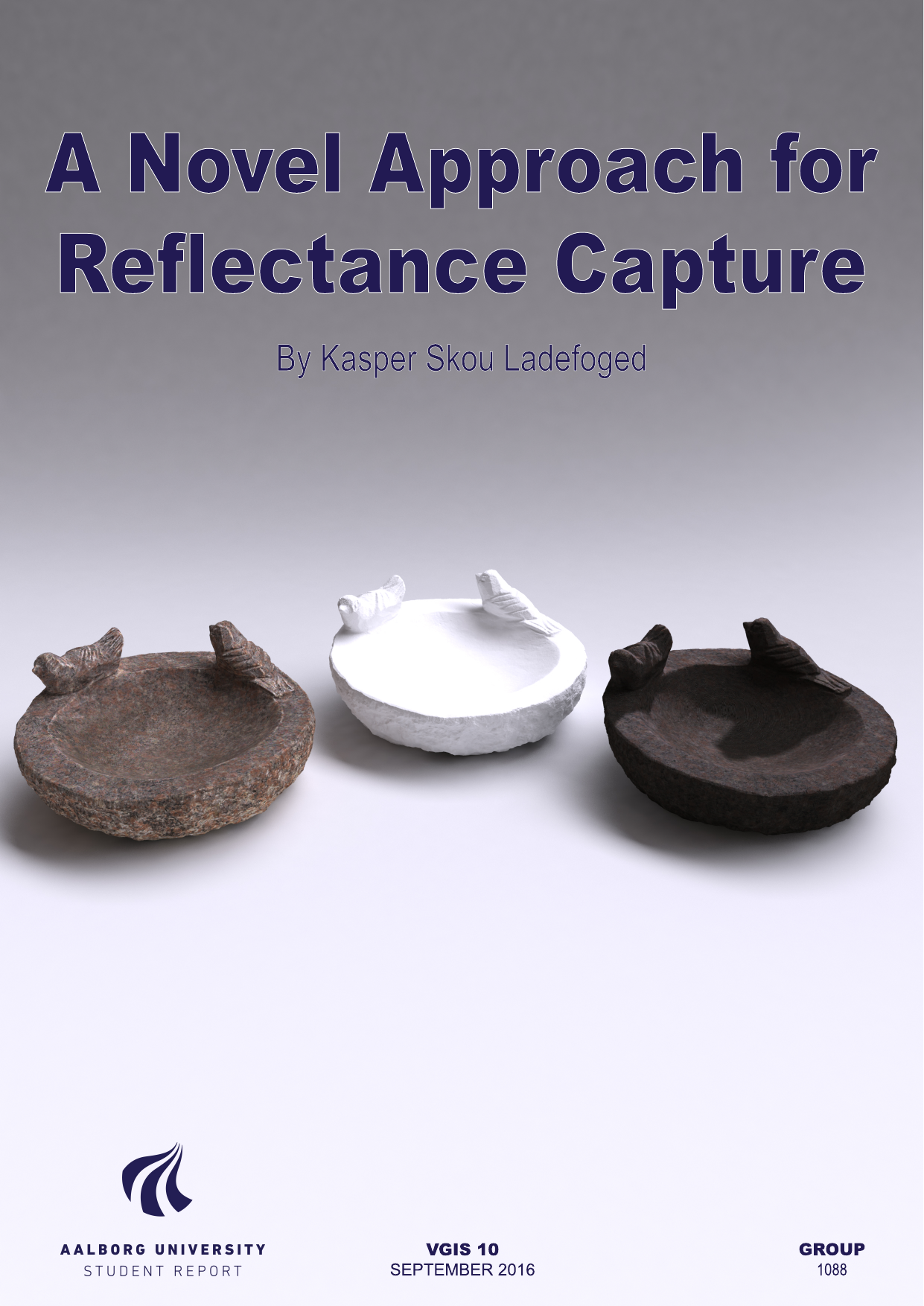

Measuring how a reconstructed object’s surface reflects light (reflectance) is useful in computer graphics. Today, this typically requires large, one-off, static setups, which limits accessibility. This project explores a more practical approach using off‑the‑shelf hardware, so real-world objects can more easily appear in augmented and virtual reality. The method captures multiple images from the same viewpoints to isolate a known light source and then estimates the object’s reflectance. To reduce error, it defines capture guidelines that keep key variables within suitable ranges. Accuracy depends mainly on how well the flash is calibrated and on the quality of the 3D reconstruction. The work therefore presents a process for calibrating the light source. The 3D reconstruction is performed with ContextCapture, which produces high-quality models and estimated camera positions and rotations. In a synthetic test, the mean error is −0.0816 on a pixel value range of 0 to 1. In real-world tests, shadows from unknown light are removed, but bright spots appear. This needs further investigation, but the results are promising.

At måle, hvordan en rekonstrueret genstands overflade reflekterer lys (reflektans), er nyttigt i computergrafik. I dag kræver det typisk store, faste og unikke opsætninger, hvilket begrænser adgangen til sådanne data. Dette projekt undersøger en mere tilgængelig metode baseret på standardudstyr som kamera og blitz, så virkelige objekter lettere kan bruges i udvidet og virtuel virkelighed. Metoden går ud på at tage flere billeder fra de samme positioner for at isolere en kendt lyskilde og derfra estimere objektets reflektans. For at begrænse fejl opstilles retningslinjer for optagelserne, så vigtige parametre holdes inden for passende intervaller. Præcisionen afhænger især af, hvor godt blitzen kalibreres, og hvor nøjagtig 3D-rekonstruktionen er. Projektet præsenterer derfor en kalibreringsproces for lyskilden. Selve 3D-rekonstruktionen udføres med ContextCapture, som giver modeller i høj kvalitet og anslåede kamerapositioner og -rotationer. I en syntetisk test opnås en middel-fejl på −0,0816 på en pixelskala fra 0 til 1. I praktiske forsøg fjernes skygger fra ukendte lyskilder, men der opstår lyse pletter. Det kræver yderligere undersøgelse, men resultaterne er lovende.

[This apstract has been rewritten with the help of AI based on the project's original abstract]

Keywords

Computer Vision ; Vision ; Computer Graphics ; Reflectance ; Reconstruction ; BRDF ; Bird Bath ; Graphics ; IBM ; Image Based Modelling