Single-Channel BLSTM Enhancement for Language Identification

Author

Frederiksen, Peter Sibbern

Term

4. semester

Education

Publication year

2018

Submitted on

2018-06-07

Pages

54

Abstract

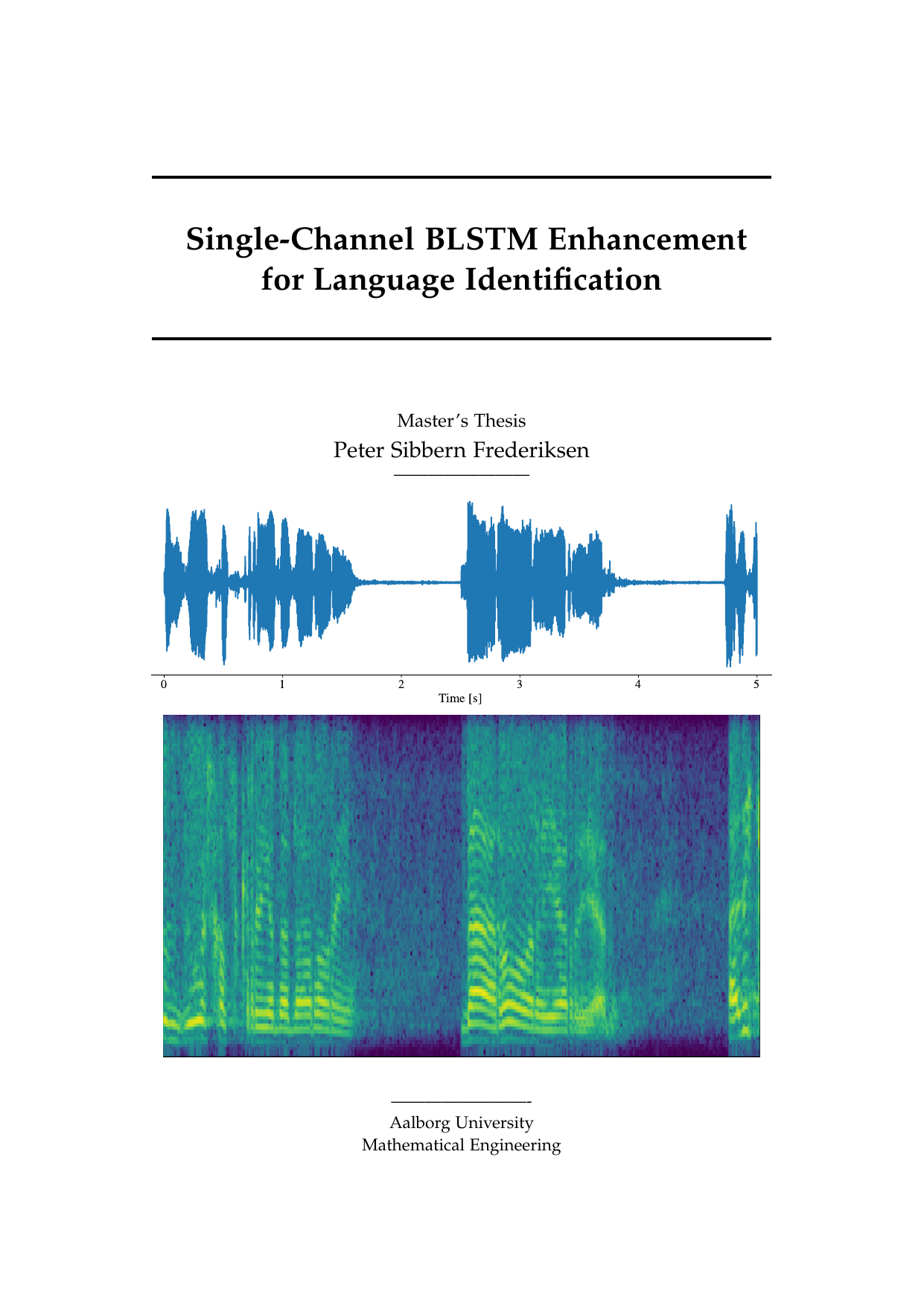

This project investigates using deep neural network–based single-channel speech enhancement as a preprocessing step for language identification—that is, deciding which language is being spoken. The 2017 Language Recognition Evaluation (LRE17) introduced noisy audio from videos in addition to the telephone speech used in past challenges. This created a mismatch between training on telephone audio and testing on video audio, which typically requires domain adaptation. Such adaptation depends on knowledge of the audio domain and access to in-domain data. Instead, we propose cleaning the noisy audio with speech enhancement before language identification. We use a BLSTM-based (bidirectional long short-term memory) deep neural network to predict a spectral mask that preserves speech-dominant time–frequency regions and suppresses noise. The mask is applied to the noisy spectrogram, and the signal is reconstructed in the time domain using the original (noisy) phase. Experiments show substantial gains in language identification on noisy speech for systems with and without domain adaptation, while maintaining performance on telephone audio. In the best adapted, state-of-the-art bottleneck i-vector system, we obtain an 11.3% relative improvement on noisy speech.

Dette projekt undersøger, hvordan dybe neurale netværk kan bruges til enkelkanals talesignalforbedring forud for sprogidentifikation – det vil sige at afgøre, hvilket sprog der tales. I 2017-udgaven af Language Recognition Evaluation (LRE17) blev der indført støjende lyd fra videoer, ud over de telefonsamtaler der har været brugt i tidligere udfordringer. Det skabte et misforhold mellem træning på telefonlyde og test på videolyde, som normalt kræver domænetilpasning af modellerne. Sådan tilpasning forudsætter både kendskab til lydens domæne og adgang til data fra samme domæne. I stedet foreslår vi at rense den støjende lyd med talesignalforbedring som forbehandling. Vi anvender en BLSTM-baseret (bidirektionel long short-term memory) DNN til at forudsige en spektral maske, der bevarer tale-dominerede tid-frekvens-områder og dæmper støj. Masken multipliceres med det støjende spektrogram, hvorefter signalet føres tilbage til tidsdomænet ved at bruge den oprindelige (støjende) fase. Vores forsøg viser markante forbedringer i sprogidentifikation på støjende tale, både for systemer med og uden domænetilpasning, samtidig med at ydeevnen på telefonoptagelser bevares. I det bedst tilpassede, state-of-the-art bottleneck i-vector-system opnår vi en relativ forbedring på 11,3% for støjende tale.

[This apstract has been rewritten with the help of AI based on the project's original abstract]

Keywords