Preserving domain knowledge in a data lake

Author

Thomsen, Mads Staberg

Term

4. term

Publication year

2022

Submitted on

2022-12-02

Pages

52

Abstract

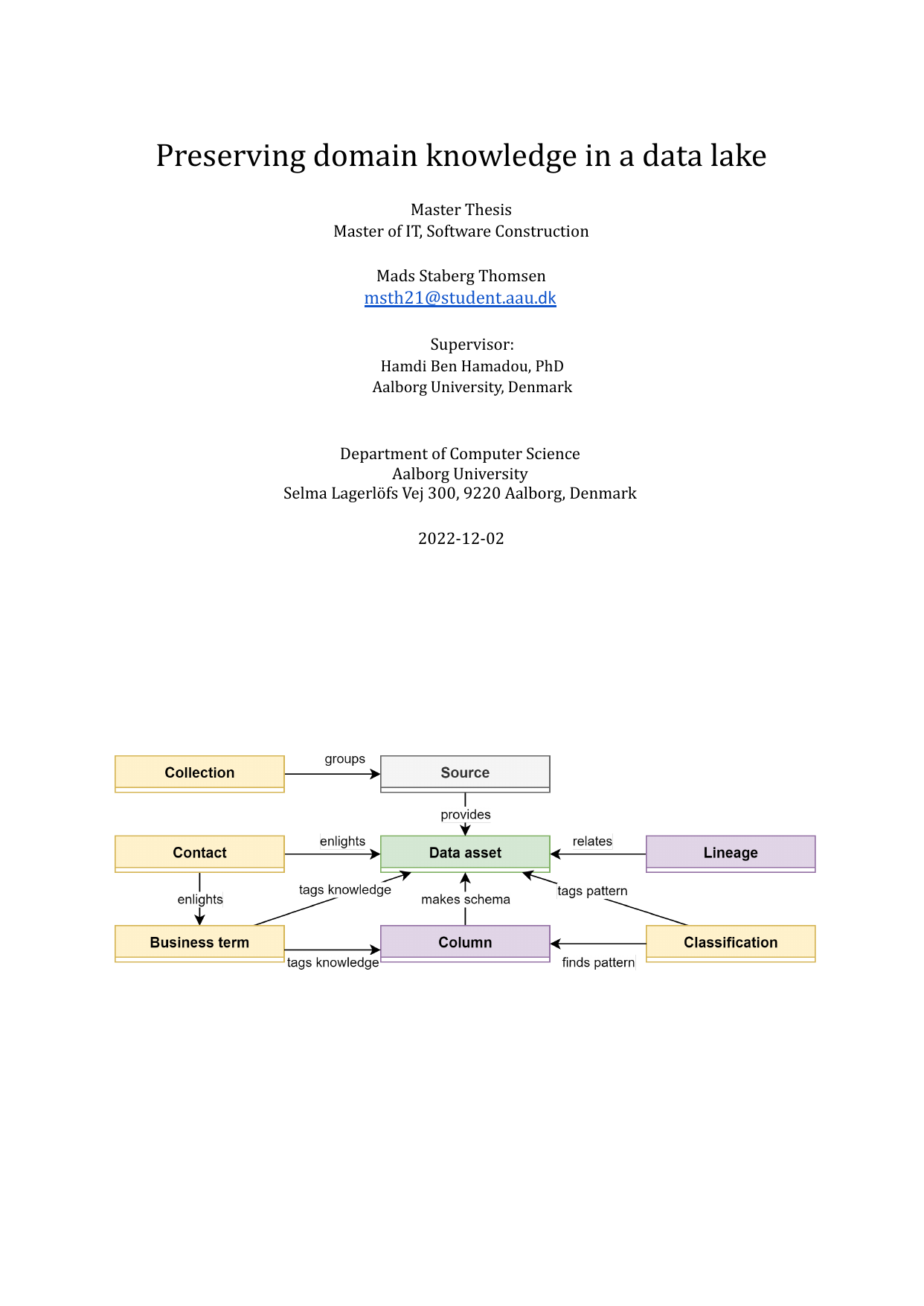

Many organizations store large volumes of raw data in a data lake (a central repository), yet struggle to understand the domain and what the data means. This thesis explores how to speed up data discovery by preserving domain knowledge as metadata (descriptive information about data). It introduces a new metadata concept that makes it more manageable to build a solid metadata foundation and implement a data catalog (a searchable inventory of available datasets). The concept is tool-, platform-, and domain-independent and guides users to add and classify metadata in the catalog. Sample datasets and their corresponding metadata are presented, and a data catalog is implemented to serve as an inventory and provide data-quality information. A small sandbox environment is set up with sample data, and a custom analysis model is used to address the challenges. To ensure reproducible analyses, scenarios are expressed using the Quality Attribute Scenario framework, a structured method with measurable response measures for qualities such as usability and performance. The usability scenarios cover automatic, manual, and semi-automatic inference of metadata into the data catalog. A performance scenario examines how implicitly inferring metadata from a structured directory affects the retrieval of data from the data lake. Each analysis is accompanied by a process map based on the metadata concept and a logbook that marks and explains user actions, documents steps, issues, solutions, and lessons learned, and clarifies partial results. Overall results are grouped by usability and performance, discussed in relation to the metadata concept and the problem statement, and key learnings are highlighted. The study concludes that domain knowledge can be preserved in a time-saving way, thereby optimizing data discovery. The best usability is achieved with semi-automatic metadata inference, and storing data in a structured directory yields the best performance. In some cases, automatic inference is also a good choice because it quickly creates searchable technical metadata—better than having no information in the catalog.

Mange organisationer lagrer store mængder rå data i en data lake (et centralt lager), men har svært ved at forstå domænet og hvad data betyder. Denne afhandling undersøger, hvordan man kan gøre dataopdagelse hurtigere ved at bevare domæneviden som metadata (beskrivende oplysninger om data). Afhandlingen præsenterer et nyt metadata-koncept, der gør det mere overkommeligt at opbygge et solidt metadatafundament og implementere et datakatalog (et søgbart katalog over tilgængelige datasæt). Konceptet er uafhængigt af værktøjer, platforme og domæner og guider brugeren i at tilføje og klassificere metadata i kataloget. Der introduceres eksemplariske datasæt og deres tilhørende metadata, og der implementeres et datakatalog, som fungerer som et inventar over tilgængelige data og giver information om datakvalitet. Et lille sandkassemiljø opstilles med prøvedata, og en skræddersyet analysemodel bruges til at håndtere udfordringerne. For at sikre reproducerbare analyser udtrykkes scenarierne i Quality Attribute Scenario-rammen, en struktureret metode med målbare responsmål for kvaliteter som brugbarhed og ydeevne. Brugbarhedsscenarierne dækker automatisk, manuelt og semi-automatisk udledning af metadata til datakataloget. Et ydeevnescenarie undersøger, hvordan implicit udledning af metadata fra en struktureret mappekatalog påvirker hentning af data fra data lake. Hver analyse ledsages af et proceskort baseret på metadata-konceptet og en logbog, der markerer og forklarer brugerhandlinger, dokumenterer trin, problemer, løsninger og læring samt delresultater. De samlede resultater grupperes efter brugbarhed og ydeevne, diskuteres i relation til metadata-konceptet og problemstillingen, og centrale indsigter fremhæves. Konklusionen er, at det er muligt at bevare domæneviden på en tidsbesparende måde og dermed optimere dataopdagelse. De bedste brugbarhedsresultater opnås med semi-automatisk udledning af metadata, og lagring af data i en struktureret mappekatalog giver den bedste ydeevne. Samtidig kan automatisk udledning i nogle tilfælde være et godt valg, fordi man hurtigt kan skabe søgbar teknisk metadata—bedre end slet ingen information i datakataloget.

[This apstract has been rewritten with the help of AI based on the project's original abstract]

Keywords