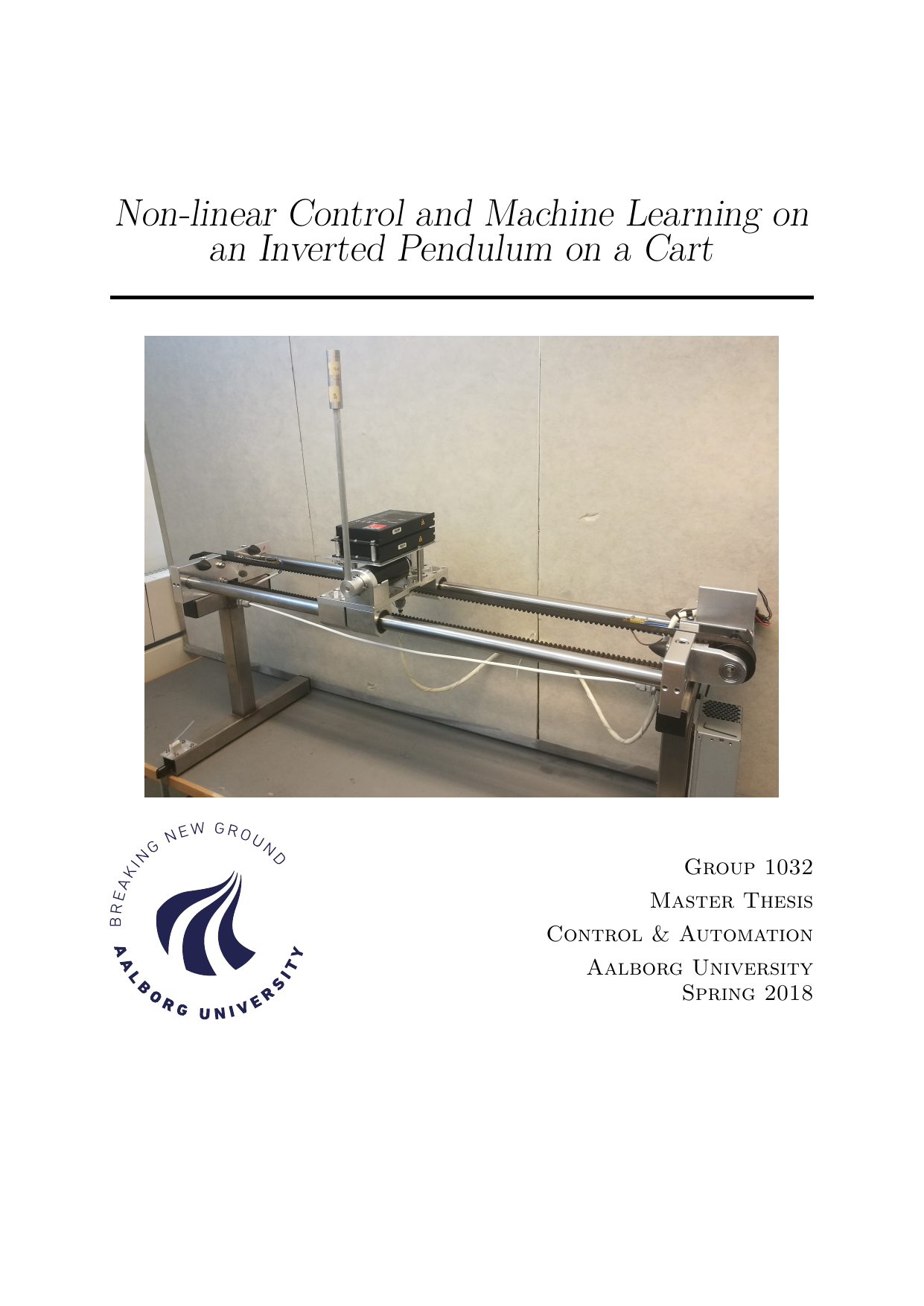

Non-linear Control and Machine Learning on an Inverted Pendulum on a Cart

Authors

Nielsen, Jonas Ørndrup ; Jørgensen, Jesper Hove Terpager

Term

4. term

Education

Publication year

2018

Pages

122

Abstract

This thesis investigates non-linear and machine-learning-based control for stabilizing an inverted pendulum on a cart. A physics-based dynamic model of the real setup is derived, parameterized, and validated, and a software architecture is implemented to allow user interaction and switching between controllers. To observe unmeasured states, an extended Kalman filter and encoder-based velocity estimation are developed, alongside friction modeling and compensation. The non-linear controller is designed as a sliding mode controller, which balances the pendulum reliably, shows robustness to parameter uncertainties, rejects disturbances, and tracks references, though with a persistent steady-state error. Reinforcement learning controllers based on Q-learning and SARSA, including trials with different hyperparameters and function approximation, converge to workable policies in simulation but achieve only brief balancing on hardware, leading us to deem these methods unsuitable for the available setup. The work thus provides a validated model, estimation tools, and an experimental framework, and compares classical non-linear control with RL on a canonical unstable system.

Denne afhandling undersøger ikke-lineær styring og maskinlæringsbaseret styring til stabilisering af et inverteret pendul på en vogn. Der udledes, parameteriseres og valideres en fysikbaseret dynamisk model af det fysiske setup, og der implementeres en programstruktur, som muliggør brugerinteraktion og skift mellem regulatorer. For at observere ikke-målbare tilstande udvikles en udvidet Kalman-filterløsning og hastighedsestimation fra encodere, suppleret af modellering og kompensation af friktion. Den ikke-lineære regulator er en sliding-mode-controller, som balancerer pendulet stabilt, er robust over for parameterusikkerheder, afviser forstyrrelser og kan følge referencer, dog med en vedvarende stationær fejl. Forstærkningslæringsbaserede regulatorer med Q-learning og SARSA, inklusive forsøg med forskellige parametervalg og funktionsapproksimation, konvergerer til brugbare løsninger i simulering, men opnår kun kortvarig balance på hardware, hvorfor metoderne vurderes uegnede til det tilgængelige setup. Arbejdet leverer dermed en valideret model, estimationsværktøjer og et eksperimentelt rammeværk og sammenligner klassisk ikke-lineær styring med RL på et kanonisk ustabilt system.

[This apstract has been generated with the help of AI directly from the project full text]

Keywords