Design of a Visual Servoing System for a SCARE type Robot to Perform a Placing Operation

Author

Roulund, Thomas Pank

Term

4. term

Education

Publication year

2017

Submitted on

2017-06-02

Pages

87

Abstract

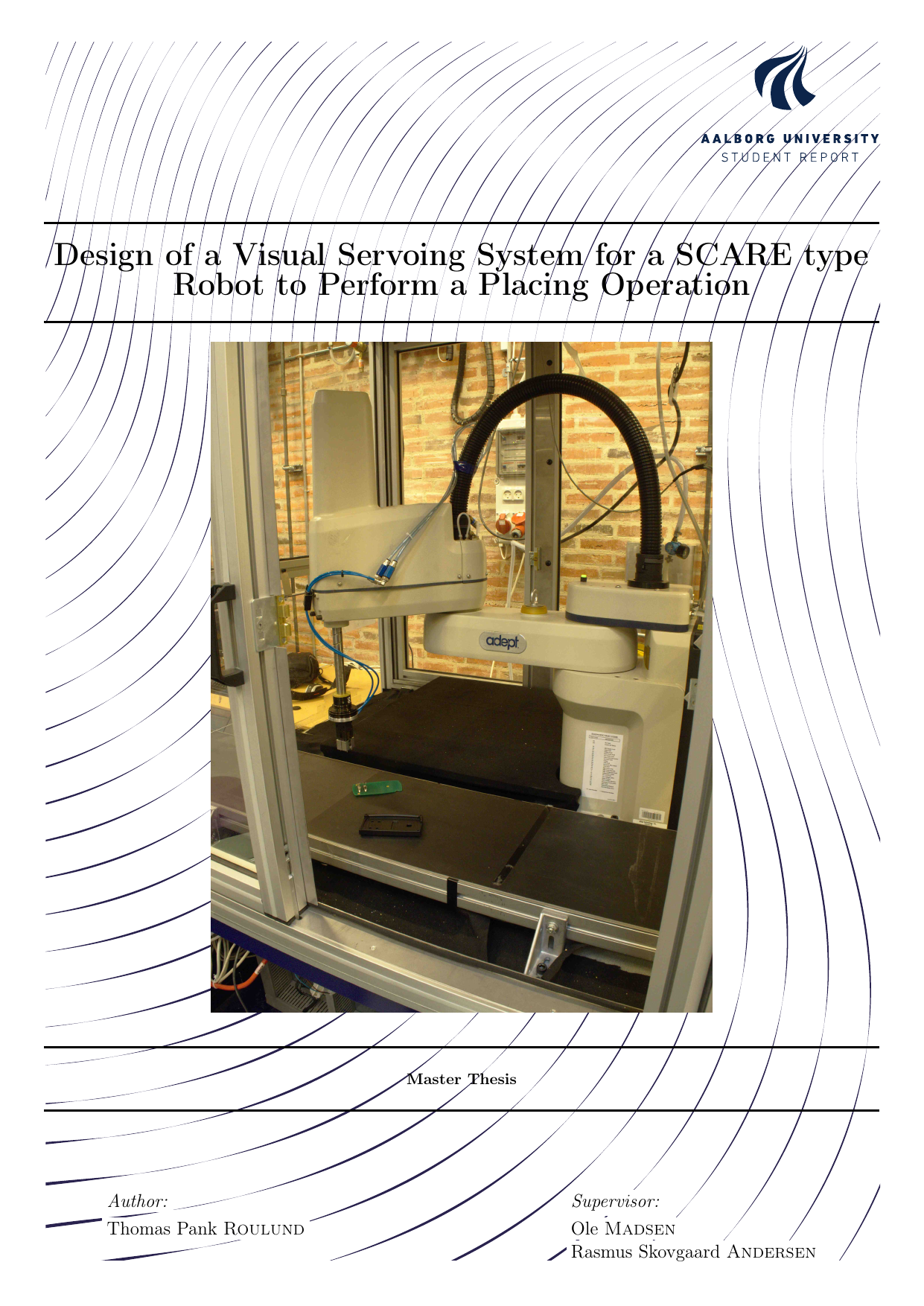

This project develops a camera-guided control system (visual servoing) for a SCARA industrial robot in Aalborg University’s Smart Lab. The goal is to help place a lid on the housing of a demo assembly while the part moves past the robot. The system is designed to be configurable and to work without any prior knowledge of the part’s position, orientation, or speed. A USB camera monitors the area, and the image is converted from RGB to the HSI color space to make detection less sensitive to lighting changes. Using simple blob detection, the system estimates the housing’s position and angle. A Kalman filter then predicts the part’s near-future position and velocity so the robot can plan an initial motion. Tests on an emulated robot showed that the built-in controller could not follow this reference without a steady-state error (a small persistent offset). To correct this, proportional–integral (PI) controllers were added to generate improved position and velocity references, reducing tracking errors to below the allowed limits. Because the robot does not have a suction cup end-effector, we could not physically verify lid placement. However, measurements on the real robot confirm it can track the reference and move as if placing the lid, and that position errors at the placement time remain within the maximum limit.

Dette projekt udvikler et kamerabaseret styresystem (visuel servostyring) til en SCARA-industrirobot i Aalborg Universitets Smart Lab. Formålet er at hjælpe med at sætte et låg på et kabinet i en demo-samleopgave, mens emnet bevæger sig forbi robotten. Systemet er konfigurerbart og fungerer uden forudgående viden om emnets position, orientering eller hastighed. Et USB-kamera overvåger området, og billedet konverteres fra RGB til HSI-farverummet for at gøre det mindre følsomt over for lysændringer. Med simpel blob-detektion estimeres kabinettets position og vinkel. Et Kalman-filter forudsiger derefter den nære fremtidige position og hastighed, så robotten kan planlægge en indledende bevægelse. Test på en emuleret robot viste, at den indbyggede controller ikke kunne følge denne reference uden en stationær fejl (en lille vedvarende afvigelse). For at rette dette blev der tilføjet proportional–integrale (PI) regulatorer, som genererede forbedrede position- og hastighedsreferencer og reducerede sporingsfejlene til under de tilladte grænser. Da robotten ikke er udstyret med en sugekop som endeffektor, kunne vi ikke fysisk verificere selve lågplaceringen. Målinger på den virkelige robot viser dog, at den kan følge referencen og bevæge sig, som om den sætter låget på, og at positionsfejlene på placeringstidspunktet ligger under maksimumgrænsen.

[This apstract has been rewritten with the help of AI based on the project's original abstract]

Keywords